[패스트캠퍼스 수강 후기] R 인강 100% 환급 챌린지 35차 미션

[패스트캠퍼스 수강 후기] R 인강 100% 환급 챌린지 35차 미션

패스트캠퍼스의 강의 중, 프로젝트와 함께 배우는 R 데이터 분석 올인원 패키지 Online를 수강하고 있습니다.

내용을 복습도 할 겸, 미션에도 참가할 겸, 블로그에 매일 매일 정리해 보게 되었습니다.

오늘은 35회차 미션!

Part 2) [R로 하는 데이터 분석] 데이터 분석 기본기 익히기

-

16. Ch 04. Naive Bayes Classification - 02. R code로 구현하는 Naive Bayes Classification

-

17. Ch 04. Naive Bayes Classification - 03. Naive Bayes Classification 결과의 해석

-

16. Ch 04. Naive Bayes Classification - 02. R code로 구현하는 Naive Bayes Classification

-

여기서도 caret을 사용

-

method만 naive_bayes를 사용

-

나이브 베이즈를 제공하는 패키지들

-

caret 내에도 총 3가지가 존재

-

naivebayes - naive_bayes

-

bnclassify - nbDiscrete, manb, awnb

-

manb - Model Averaged naive Beyes

-

모든 가능한 피쳐조합의 조건부확률의 평균

-

지난 시간의 배드민턴에서 4개의 피처들 중,

-

일부만 쓰거나, 날씨와 바람을 조합한 경우를 하나의 조건으로 쓴다든지...

-

즉, 여러가지 가능성의 평균을 활용

-

awnb

-

조건부 확률에 가중치를 부여

-

klaR

-

여기서 강사는 naive_bayes를 추천

-

편리함을 중요하게 생각함

-

결국 입력값을 넣어서 결과를 얻어야 하는데,

-

각 패키지 방식에 맞게 입력값을 맞춰서 넣어줘야 하는데,

-

naive_bayes가 제일 편하다.

-

17. Ch 04. Naive Bayes Classification - 03. Naive Bayes Classification 결과의 해석

-

아래와 같은 결과가 나옴

-

usekernel

-

adjust?

-

laplac?

-

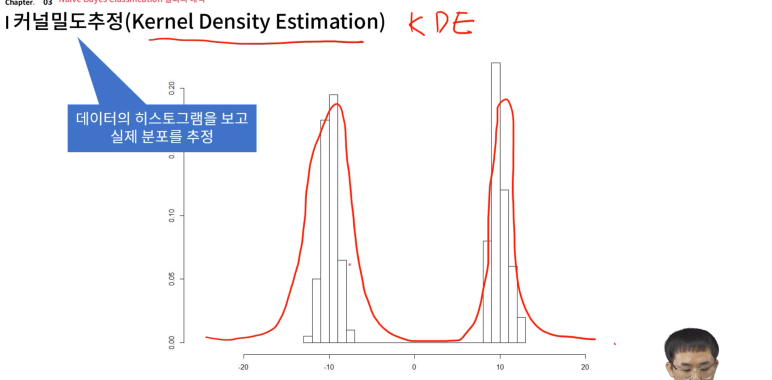

커널 밀도 추정 (Kernal Density Estimation) KDE

-

데이터의 히스토그램을 보고 실제 분포를 추정

-

이 히스토그림이 계단형을 부드럽게 해주는 과정은 smoothing이라고 부름

-

adjust

-

bandwidth?

-

bandwidth를 변경하여 추정 커널밀도 함수의 높이 등이 달라짐

-

실제 분포에 가까운 함수를 추정

-

adjust -> bandwidth값을 바꾼다는 의미

-

laplas

-

라플라스 스무딩 (Laplace smoothing or Additive Smoothing)

-

스무딩의 한 방식을 말함

-

식은 몰라도 되고, 아래와 같이 계단형을 부드러운 곡선으로 만든다는 것만 이해하면 됨.

-

알파가 0이면 그냥 x/N

-

동전을 10번 던져서 앞면이 4번 나왔다면

-

4/10

-

이게 일반적

-

그런데 뒤의 알파가 들어간 식을 넣는 이유?

-

동전을 무수히 많이 던졌으면 모를까, 몇번 안던졌다고 하자

-

4번 던졌는데, 앞면이 0번 나올 수도 있음

-

그러면 앞면이 나올 확률은 0.

-

하지만 이런 극단적인 경우를 막기 위한 처리

-

역으로 100%도 보정

-

다시 정리하면 아래와 같다

-

usekernel은 커널의 사용 여부

-

adjust는 bandwidth을 어떻게 조절할 지

-

laplace는 알파값을 어떻게 할 것인가?

기본적인 이론만 다루었음

다음 시간의 예제를 봐야 좀 더 이해가 갈 듯